python pandas模糊匹配 讀取Excel后 獲取指定指標的操作

數據代表了各個城市店鋪的裝修和配置費用,要統計出裝修和配置項的總費用并進行加和計算;

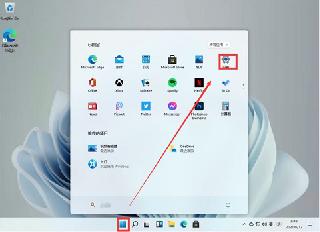

2.pandas實現過程import pandas as pd#1.讀取數據df = pd.read_excel(r’./data/pfee.xlsx’)print(df)

cols = list(df.columns)print(cols)

#2.獲取含有裝修 和 配置 字段的數據zx_lists=[]pz_lists=[]for name in cols: if ’裝修’ in name: zx_lists.append(name) elif ’配置’ in name: pz_lists.append(name)print(zx_lists)print(pz_lists)

#3.對裝修和配置項費用進行求和計算df[’裝修-求和’] =df[zx_lists].apply(lambda x:x.sum(),axis=1)df[’配置-求和’] = df[pz_lists].apply(lambda x:x.sum(),axis=1)print(df)

補充:pandas 中dataframe 中的模糊匹配 與pyspark dataframe 中的模糊匹配

1.pandas dataframe匹配一個很簡單,批量匹配如下

df_obj[df_obj[’title’].str.contains(r’.*?n.*’)] #使用正則表達式進行模糊匹配,*匹配0或無限次,?匹配0或1次

pyspark dataframe 中模糊匹配有兩種方式

2.spark dataframe api, filter rlike 聯合使用df1=df.filter('uri rlike ’com.tencent.tmgp.sgame|%E8%80%85%E8%8D%A3%E8%80%80_|android.ugc.live| %e7%88f%e8%a7%86%e9%a2%91|%E7%%8F%E8%A7%86%E9%A2%91’').groupBy('uri'). count().sort('count', ascending=False)

注意點:

1.rlike 后面進行批量匹配用引號包裹即可

2.rlike 中要匹配特殊字符的話,不需要轉義

3.rlike ’bappleb’ 雖然也可以匹配但是匹配數量不全,具體原因不明,歡迎討論。

In [5]: df.filter('name rlike ’%’').show()+---+------+-----+|age|height| name|+---+------+-----+| 4| 140|A%l%i|| 6| 180| i%ce|+---+------+-----+3.spark sql

spark.sql('select uri from t where uri like ’%com.tencent.tmgp.sgame%’ or uri like ’douyu’').show(5)

如果要批量匹配的話,就需要在后面繼續添加uri like ’%blabla%’,就有點繁瑣了。

對了這里需要提到原生sql 的批量匹配,regexp 就很方便了,跟rlike 有點相似

mysql> select count(*) from url_parse where uri regexp ’android.ugc.live|com.tencent.tmgp.sgame’;+----------+| count(*) |+----------+| 9768 |+----------+1 row in set (0.52 sec)

于是這里就可以將sql中regexp 應用到spark sql 中

In [9]: spark.sql(’select * from t where name regexp '%l|t|_'’).show()+---+------+------+|age|height| name|+---+------+------+| 1| 150|Al_ice|| 4| 140| A%l%i|+---+------+------+

以上為個人經驗,希望能給大家一個參考,也希望大家多多支持好吧啦網。如有錯誤或未考慮完全的地方,望不吝賜教。

相關文章:

網公網安備

網公網安備